Bei Liberogic arbeiten wir daran, die Struktur unserer Website für KI-Agenten und LLMs lesbarer zu gestalten.

Es ist mittlerweile üblich, dass nicht nur Suchmaschinen, sondern auch LLMs und KI-Agenten wie Claude, Gemini und ChatGPT Webseiten lesen, Informationen organisieren und vergleichen sowie Recherchen im Auftrag von Nutzern durchführen.

Auf der Liberogic-Website bereiten wir uns ebenfalls darauf vor, dass KI unsere Inhalte lesen kann, indem wir robots.txt, Sitemap, Link-Header, llms.txt erstellen und für jeden Artikel Markdown-Dateien generieren.

Dieses Mal hat Cloudflare vor zwei Wochen etwas veröffentlicht.「Is Your Site Agent-Ready?」Ich werde einen Artikel zu diesem Thema schreiben.

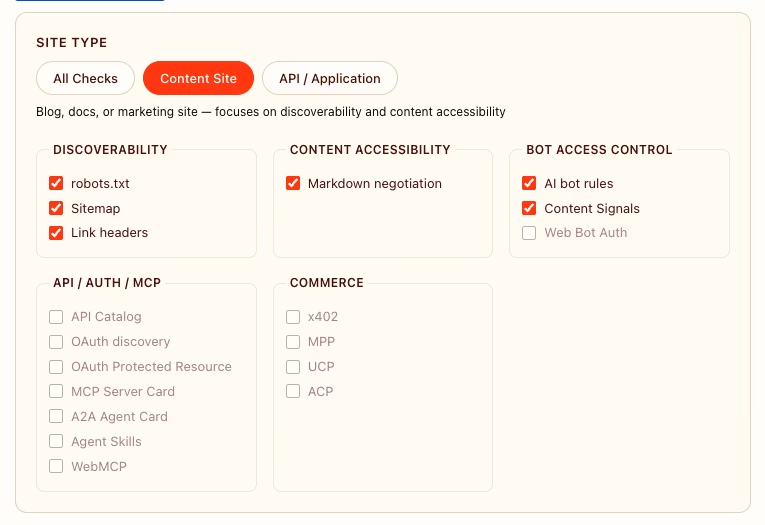

Als Inhaltsseite geprüft

Die Website von Liberogic ist eine Unternehmens- und Inhaltsseite mit Firmeninformationen, Servicevorstellungen, Nachrichten, Kolumnen, Fallstudien und mehr. Sie ist weder ein Onlineshop noch eine API-Anwendung, die eine OAuth-Authentifizierung erfordert.

Der Website-Typ während der Serverprüfung ist「Content Site」Wählen Sie eines aus.

Commerce- und API/Auth/MCP-bezogene Aspekte werden von dieser Bewertung ausgeschlossen; wir konzentrieren uns primär auf die folgenden Aspekte.

- Discoverability

- Content Accessibility

- Bot Access Control

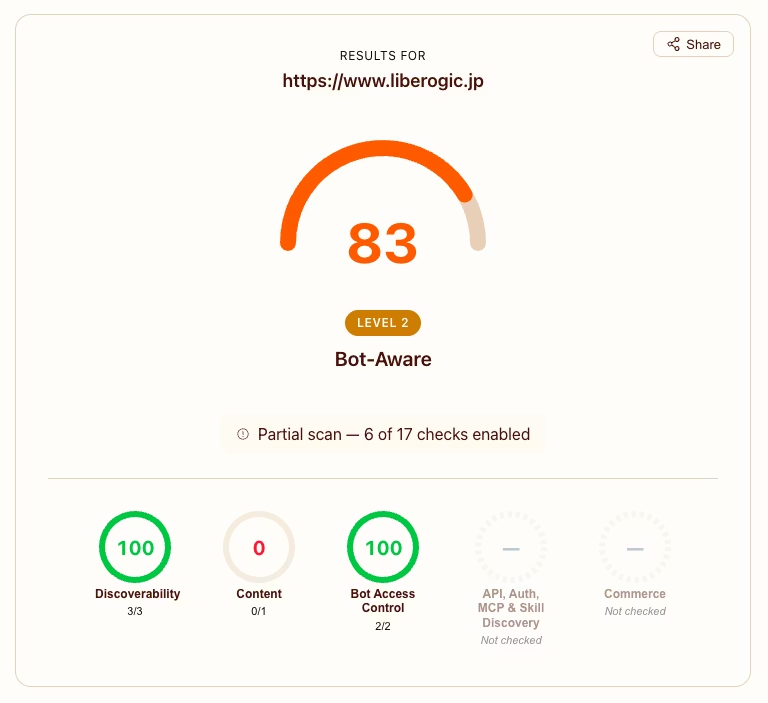

Als Ergebnis lautet das Ergebnis:83 Tage, Level 2 „Bot-Aware“Das ist passiert 😭

Warum ist es keine Höchstpunktzahl?!

Lass es uns gleich überprüfen/bestätigen.

Bei diesem Check erzielten sowohl Discovery als auch Bot Access Control 100 Punkte.

Wir haben die Unterstützung für Elemente wie robots.txt, Sitemap, Link-Header, KI-Bot-Regeln und Content Signals implementiert und die grundlegenden Wege geschaffen, damit der KI-Bot die Website entdecken und die Zugriffsrichtlinien verstehen kann.

Einfach ausgedrückt:

- Sorgen Sie dafür, dass die Leute die Website entdecken.

- Teilen Sie uns mit, wo sich der Inhalt befindet.

- Hierin werden die Zugriffsrichtlinien für Bots beschrieben.

- Signale für KI

Dies sind die Bereiche, die bereits behandelt wurden.

Andererseits erhielt ich für die Barrierefreiheit von Inhalten (TT) die Note 0.

Wenn man nur das betrachtet, könnte man denken: „Moment mal, ich kann den Inhalt nicht lesen?“, aber die Realität sieht etwas anders aus.

Der Markdown-Inhalt selbst ist bereits vorbereitet.

Auf der Webseite von Liberogic wird ein gewisser Prozentsatz der Artikelinhalte und Fallstudien bereits im Markdown-Format generiert, das für KI leicht lesbar ist.

Sowohl Artikel als auch Fallstudien enthalten Markdown-Dateien, und der Kopfbereich jeder Seite enthält einen Link-Tag zum Markdown-Inhalt, wodurch dem KI-Agenten ein klarer Pfad zum Zugriff auf die Markdown-Dateien geboten wird.

Es liegt nicht daran, dass es Markdown nicht unterstützt; vielmehr ist LLM so konzipiert, dass der Text in einem lesbaren Format abgerufen wird, es handelt sich also nicht um einen Fall, in dem er "nicht für die KI lesbar" wäre.

Warum bekomme ich keine perfekte Punktzahl? 👺

Der Grund, warum diesmal keine 100 Punkte erzielt wurden, liegt nicht darin, dass die Website nichts getan hat, sondern in der Inkompatibilität zwischen der aktuellen Implementierungskonfiguration und den Bewertungsspezifikationen des Prüfwerkzeugs.

Die Liberogic-Website wurde mit Astros SSG implementiert, die Vorschauseite ist ein Hybrid-Design unter Verwendung von SSR.

Während die Markdown-Aushandlung üblicherweise über Middleware erfolgt, nutzt die Hybridkonfiguration einen Cloudflare-Adapter, dessen Ausgabedatei _worker.js Vorrang hat. Daher kann die Middleware nicht geladen werden, und die Markdown-Aushandlung wird im Prüftool nicht angezeigt.

Tatsächlich existiert eine Markdown-Datei, die über einen Link-Tag im Head-Bereich aufgerufen werden kann, aber das Prüftool meldete: „Markdown-Aushandlung nicht erkannt!“

Verdammt! Das ist ja nur ein halbfertiges Produkt!

...Obwohl ich in Versuchung gerate, das zu sagen, verlasse ich mich natürlich jeden Tag auf Cloudflare.

Vielen Dank für die Genehmigung unserer Partnerzertifizierung.

Aber für jemanden, der in Lighthouse nach der Höchstpunktzahl gestrebt hat, ist das etwas enttäuschend.

Es ist möglich, die volle Punktzahl zu erreichen! Aber ich möchte weder die betriebliche Effizienz opfern noch zusätzliche Kosten in Kauf nehmen, nur um eine hohe Punktzahl zu erzielen.

Es gibt mehrere mögliche Lösungen.

- Eine separate Cloudflare Workers-Instanz ist eingerichtet, um Markdown zurückzugeben.

- Konvertieren Sie die Vorschauseite in eine CSR und nähern Sie sie einer vollständigen SSG-Konfiguration an.

- Ändern Sie den Cloudflare-Tarif in einen Business-Tarif und schreiben Sie URLs mithilfe von Transformationsregeln um.

Dies sind einige der Methoden.

Das ist richtig, eine Anhebung des Servicelevels von Cloudflare um eine Stufe würde die Punktzahl des Prüftools näher an 100 bringen.

Allerdings erscheint es zum jetzigen Zeitpunkt etwas fragwürdig, dafür extra zu bezahlen!

Unser Ziel ist nicht, bei einem Prüftool die Höchstpunktzahl zu erreichen, sondern sicherzustellen, dass KI-Systeme und LLMs die Informationen auf der Liberogic-Website korrekt interpretieren können. Aus Sicht der LLMs, die die Inhalte lesen, haben wir unserer Ansicht nach erhebliche Fortschritte bei der Umsetzung der notwendigen Schritte erzielt.

Ansondern ein die Kosten nur für eine perfekte Punktzahl zu erhöhen, sollte man sich darauf konzentrieren, richtig lesen zu können.

Es muss ordnungsgemäß bedienbar sein.

Als Unternehmen der Liberology-Bewegung möchten wir diesem Gleichgewicht höchste Priorität einräumen.

Vergiss die Datei llms.txt nicht!

Obwohl es nicht in dieser Checkliste enthalten ist, findet es bei Liberology.../llms.txtEs unterstützt dies ebenfalls.

Die Datei llms.txt dient als Inhaltsverzeichnis für LLM und informiert darüber, „welche Informationen auf dieser Website vorhanden sind und welche Seiten gelesen werden sollen“.

Dieses Konzept ähnelt der sitemap.xml für Suchmaschinen, eignet sich aber besser für LLMs, da es dazu dient, die Übersicht der Website zu organisieren und Wege zu wichtigen Inhalten zu bieten.

Obwohl es nicht in den Prüfpunkten des Check-Tools enthalten ist, legt Cloudflare großen Wert auf Datenqualität, insbesondere darauf, „wie gut der Inhalt (Textkörper) mit minimalem Rauschen abgerufen werden kann (d. h. ob er im Markdown-Format vorliegt)“, sodass sie es möglicherweise absichtlich weggelassen haben.

Soll ich es einfach den HTML-Code direkt einlesen lassen?

Wenn ein KI-Agent eine Webseite liest, kann er natürlich auch direkt den HTML-Code analysieren.

Tatsächliche Webseiten enthalten jedoch neben dem Hauptinhalt zahlreiche weitere Informationen, wie Navigation, Kopf- und Fußzeilen, dekorative Elemente und JavaScript-Steuerelemente. Selbst Seiten, die natürlich wirken, weisen oft viele Störfaktoren auf, die für eine LLM-Analyse (Low-Level Matrix) relevant sind.

Die erzwungene Umwandlung von komplexem HTML in Markdown kann die Überschriftenstruktur, Listen und die beabsichtigte Bedeutung beeinträchtigen und unter Umständen zu Daten führen, die selbst für LLMs schwer lesbar sind.

Während ich das sage, bin ich mir sicher, dass sich diese Probleme mit dem Fortschritt der KI bald lösen werden. Dennoch halte ich es für wichtig, jetzt das Notwendige zu tun, Schritt für Schritt. Wie weit sind Ihre Websites in Bezug auf die KI-Implementierung?

Obwohl er CEO ist, ist er stets ein Ansprechpartner für die Mitarbeiter. Er hat Freude daran, neue Technologien zu verstehen und praktische Verbesserungen mitzuerleben. Er ist ein engagierter und tatkräftiger Mensch, der sich voll und ganz seiner Arbeit widmet. Er ist begeistert von Zukunftstechnologien und möchte, unabhängig von seinem Alter, weiterhin neue Erfahrungen sammeln.

Morimoto

Projektmanager / Direktor / Gegründet 2007