Bij Liberogic werken we eraan om de structuur van onze website leesbaarder te maken voor AI-agenten en LLM's.

Het is niet alleen gebruikelijk geworden dat zoekmachines, maar ook dat LLM's en AI-agenten zoals Claude, Gemini en ChatGPT websites lezen, informatie ordenen en vergelijken, en onderzoek uitvoeren namens gebruikers.

Op de website van Liberogic bereiden we ons ook voor op AI die onze content leest door robots.txt, een sitemap, linkheaders, llms.txt en Markdown-bestanden voor elk artikel te genereren.

Deze keer heeft Cloudflare twee weken geleden iets uitgebracht.「Is Your Site Agent-Ready?」Ik zal hierover een artikel schrijven.

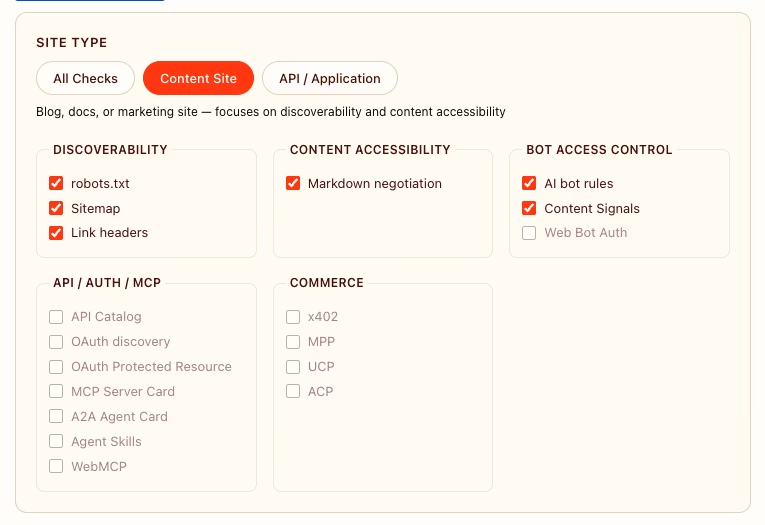

Gecontroleerd als een contentwebsite

De website van Liberogic is een bedrijfs- en contentwebsite met informatie over het bedrijf, introducties van diensten, nieuws, columns, casestudy's en meer. Het is geen e-commercewebsite en ook geen API-applicatie die OAuth-authenticatie vereist.

Het sitetype tijdens de servercontrole is「Content Site」Kies er één.

Commerciële aspecten en API-/authenticatie-/MCP-gerelateerde zaken worden uitgesloten van deze evaluatie. We zullen ons voornamelijk richten op de volgende aspecten.

- Discoverability

- Content Accessibility

- Bot Access Control

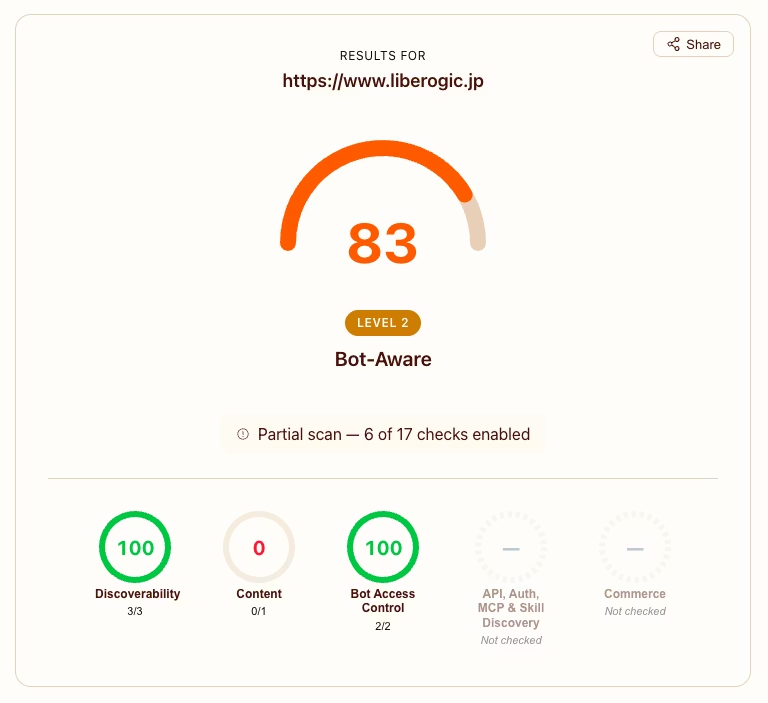

Het resultaat is... de score83点、Niveau 2「Botbewust」Dit is wat er gebeurde 😭

Waarom is het geen perfecte score?!

Laten we het meteen controleren/bevestigen.

Bij deze controle behaalden zowel Discovery als Bot Access Control een score van 100 punten.

We hebben ondersteuning geïmplementeerd voor elementen zoals robots.txt, sitemap, linkheaders, AI-botregels en contentsignalen, en we hebben de basispaden vastgelegd waarmee de AI-bot de site kan ontdekken en het toegangsbeleid kan begrijpen.

Simpel gezegd,

- Zorg ervoor dat mensen de site ontdekken.

- Vertel ons waar de inhoud zich bevindt.

- Hierin wordt het toegangsbeleid voor bots beschreven.

- Signalen voor AI

Dat zijn de gebieden die al aan de orde zijn geweest.

Aan de andere kant kreeg ik een score van 0 voor Toegankelijkheid van de inhoud (TT).

Als je hier alleen naar kijkt, denk je misschien: "Wacht, ik kan de inhoud niet lezen?", maar de werkelijkheid is iets anders.

De Markdown-inhoud zelf is al voorbereid.

Op de website van Liberogic is een bepaald percentage van de artikelinhoud en casestudies al gegenereerd in Markdown-formaat, wat gemakkelijk door AI kan worden gelezen.

Zowel artikelen als casestudies bevatten Markdown-bestanden, en de head-sectie van elke pagina bevat een link-tag naar de Markdown-inhoud, waardoor de AI-agent een duidelijk pad heeft om toegang te krijgen tot de Markdown-bestanden.

Het is niet zo dat het geen Markdown ondersteunt; LLM is juist ontworpen om de tekst in een leesbaar formaat op te halen, dus het is niet zo dat de tekst "niet geschikt is om door AI te worden gelezen".

Waarom krijg ik dan geen perfecte score? 👺

De reden dat de score deze keer geen 100 was, is niet omdat de site niets deed, maar vanwege de incompatibiliteit tussen de huidige implementatieconfiguratie en de evaluatiespecificaties van de controletool.

De Liberogic-website is geïmplementeerd met Astro's SSG, en de previewpagina is een hybride ontwerp dat gebruikmaakt van SSR.

Hoewel de Markdown-onderhandeling doorgaans door middleware wordt afgehandeld, maakt de hybride configuratie gebruik van een Cloudflare-adapter, en de uitvoer daarvan, _worker.js, krijgt voorrang. Hierdoor laadt de middleware niet en wordt de Markdown-onderhandeling niet weergegeven in de controletool.

In werkelijkheid bestaat er wel degelijk een Markdown-bestand, dat toegankelijk is via een link-tag in de head-sectie, maar de controletool gaf de foutmelding "Markdown-onderhandeling niet gedetecteerd!".

Verdomme! Ze hebben iets halfslachtigs gemaakt!

...Hoewel ik geneigd ben dat te zeggen, vertrouw ik natuurlijk dagelijks op Cloudflare.

Bedankt voor het goedkeuren van onze partnercertificering.

Maar als iemand die ernaar streefde een perfecte score te behalen in Lighthouse, is dit toch een beetje teleurstellend.

Het is mogelijk om een perfecte score te halen! Maar ik wil de operationele efficiëntie niet opofferen of extra kosten maken, alleen maar om een hoge score te behalen.

Er zijn verschillende mogelijke oplossingen.

- Er wordt een aparte Cloudflare Workers-instantie opgezet om de Markdown-output te retourneren.

- Converteer de voorbeeldpagina naar een CSR en werk deze verder uit richting een complete SSG-configuratie.

- Wijzig het serviceabonnement van Cloudflare naar een businessabonnement en herschrijf URL's met behulp van transformatieregels.

Dit zijn enkele van de methoden.

Dat klopt, door het serviceniveau van Cloudflare met één stap te verhogen, zou de score op de controletool dichter bij de 100 komen.

Het lijkt echter op dit moment wat twijfelachtig om daarvoor extra te betalen!

Ons doel is niet om een perfecte score te behalen op een controletool, maar eerder om ervoor te zorgen dat AI-agenten en LLM's de informatie op de Liberogic-website correct kunnen interpreteren. Vanuit het perspectief van LLM's die de inhoud lezen, zijn we van mening dat we aanzienlijke vooruitgang hebben geboekt in het nemen van de noodzakelijke stappen.

In plaats van de kosten te verhogen om een perfecte score te halen, kun je je beter richten op het goed kunnen lezen.

Het moet naar behoren te bedienen zijn.

Als onderdeel van Liberology willen we die balans vooropstellen.

Vergeet llms.txt niet!

Hoewel het niet in deze checklist is opgenomen, is het bij Liberology wel beschikbaar./llms.txtHet ondersteunt dit ook.

llms.txt is een bestand dat fungeert als een inhoudsopgave voor LLM en aangeeft "welke informatie op deze site te vinden is en welke pagina's gelezen moeten worden."

Dit concept is vergelijkbaar met sitemap.xml voor zoekmachines, maar het is beter geschikt voor LLM's, waar het dient om het overzicht van de site te organiseren en paden naar belangrijke content te bieden.

Hoewel het niet is opgenomen in de inspectiepunten van de controletool, hecht Cloudflare veel waarde aan datakwaliteit, met name aan "hoe goed de inhoud (de tekst) kan worden vastgelegd met minimale ruis (d.w.z. of deze in Markdown-formaat is)", dus het is mogelijk dat ze dit opzettelijk hebben weggelaten.

Moet ik het de HTML gewoon direct laten lezen?

Wanneer je een AI-agent een website laat lezen, kun je hem natuurlijk ook direct de HTML laten analyseren.

Echte webpagina's bevatten echter veel meer informatie dan alleen de hoofdinhoud, zoals navigatie, kopteksten, voetteksten, decoratieve elementen en JavaScript-besturingselementen. Zelfs pagina's die er natuurlijk uitzien, bevatten vaak veel ruis voor LLM-analyse (Low-Level Matrix).

Het geforceerd omzetten van complexe HTML naar Markdown kan de kopstructuur, lijsten en de beoogde betekenis verstoren, waardoor de gegevens mogelijk zelfs voor LLM's moeilijk leesbaar worden.

Terwijl ik dit zeg, ben ik ervan overtuigd dat deze problemen met de vooruitgang van AI snel zullen verbeteren, maar ik denk dat het belangrijk is om nu te doen wat nodig is, stap voor stap. Hoe ver zijn jullie websites gevorderd met de implementatie van AI?

Ondanks zijn functie als CEO blijft hij altijd een gelijkwaardige gesprekspartner. Hij haalt plezier uit het begrijpen van nieuwe technologieën en het ervaren van momenten van gemak. Hij is een praktische, toegewijde persoon die zich volledig in zijn werk stort. Hij is enthousiast over toekomstige technologieën en wil, ongeacht zijn leeftijd, blijven genieten van nieuwe ervaringen.

Morimoto

Projectmanager / Directeur / Opgericht in 2007